2018级博士研究生陈文河的论文“Gaze Estimation via the Joint Modeling of Multiple Cues”被国际期刊IEEE Transactions on Circuits and Systems for Video Technology,TCSVT(CCF B类期刊)接收。另外一篇“Bottom-Up Improved Multistage Temporal Convolutional Network for Action Segmentation”被国际期刊Applied Intelligence,APIN(CCF C类期刊)接收,目前已在线发表。论文的通讯作者都为孔俊教授和郑彩侠老师。陈文河于2018年进入东北师范大学信息科学与技术学院孔俊教授的数据分析与智能感知团队攻读博士学位。

期刊简介:TCSVT由IEEE出版,是一本同行评议的科学期刊,涵盖所有视频技术的电路和系统方面的工作。同时,它鼓励发表与图像/视频建模相关的研究论文。

期刊名称:IEEE Transactions on Circuits and Systems for Video Technology

期刊类别:中科院1区(中国计算机学会推荐B类期刊)

第一作者:陈文河

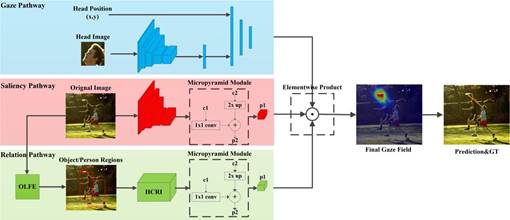

论文题目:Gaze Estimation via the Joint Modeling of Multiple Cues

论文概述:视线估计(Gaze Estimation)是理解人类意图和预测人类在各种社会背景下行为的重要手段,是人工智能领域的热点问题。以往对这一问题的研究存在诸多约束,如场景受限、输入严格且复杂等。为了减少约束条件,在现实场景下预测他人的视线方向,我们提出一个三路径网络(Three-pathway Network, TPNet),通过多个线索的联合建模来估计视线。具体来说,首先设计了一个以人为中心的关系推理模块(Human-centric Relationship Inference, HCRI)来学习场景中目标人物与周围人/物之间的对象级关系。然后,构建了一个新的深度网络TPNet,通过三条路径融合场景显著性、对象级关系和头部信息等多重线索来预测人眼注视方向。此外,为了提取网络训练过程中的多层次特征,构建并嵌入了一个微型金字塔模块(Micropyramid Module)。大量的定量和定性实验结果验证了所提方法能够获得鲁棒的结果,并且显著优于现有的视线估计方法。

期刊简介:APIN由SPRINGER出版社出版,是一本同行评议的科学期刊,以人工智能和神经网络研究为重点。同时,它发表与图像/视频建模相关的研究论文。

期刊名称:Applied Intelligence

期刊类别:中科院2区(中国计算机学会推荐C类期刊)

第一作者:陈文河

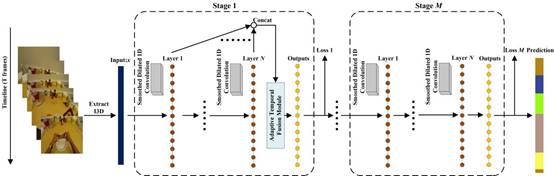

论文题目:Bottom-Up Improved Multistage Temporal Convolutional Network for Action Segmentation

论文概述:行为分割(Action Segmentation)是指在未修剪的长视频中对人的行为片段进行定位和分类,其对理解人类行为非常重要。针对行为分割普遍存在的模糊帧问题,当前的研究通常添加一些额外的输入或高度复杂的模块来提高行为分割网络的性能。然而,这些额外的输入难以获得,并且添加高度复杂的模块会极大占用计算资源和存储成本。为了解决这些问题,我们提出一种自下而上改进的多阶段时间卷积网络(Bottom-Up Improved Multistage Temporal Convolutional Network,BUIMS-TCN)。首先,提出了一种平滑空洞一维卷积来学习视频中的局部时间依赖性,以此减轻原始空洞一维卷积带来的网格伪影问题,以此缓解模糊帧问题。其次,设计了一种自适应时间融合模块,该模块不仅可以自适应地融合多尺度上下文信息,还能进一步减少由残差连接带来的网格伪影问题。最后,引入了一个新的损失函数来解决难易样本数量不平衡造成的模糊帧问题,进一步提高视频动作分割的准确性。与现有方法不同,网络是端到端训练的,无需额外的人工成本来给网络提供更多的输入信息,只需要很少的参数就可以获得当前最优的性能,明显优于现有的行为分割方法。